Avec la popularisation du potentiel de l’IA, de plus en plus d’interlocuteurs auxquels on explique la démarche de modélisation nous interrogent: « pourquoi ne pas utiliser l’IA au lieu de passer du temps à modéliser, implémenter, vérifier, simuler » ? La réponse.

L’un des cas d’usage de l’IA souvent mentionné est l’aide à la décision. Par exemple dans des articles de presse spécialisée [1], [autres exemples à venir]

L’IA: de quoi parle-t-on ?

L’apprentissage automatique

On entend généralement par IA les méthodes récemment popularisées sur l’apprentissage automatique (machine learning), dont les outils incluent des mots clés maintenant plus populaires comme les réseaux de neurone profonds, des outils comme TensorFlow, etc. Dans ces techniques, on choisi un modèle d’apprentissage. Un tel modèle associe à une entrée (une image, un texte, des données de capteur, des sons…) à une sortie (classification, texte, annotation, émotion détectée…). Il faut d’abord l’entraîner sur un jeu de données sur lesquelles on connaît le résultat attendu (un jeu de données dit « étiqueté »), qui doit être vaste et représentatif de la diversité des situations possibles. Pendant l’entraînement, les formules mathématiques qui régissent le fonctionnement du modèle sont paramétrées. Au fil de l’apprentissage, le modèle devient capable d’abstraire certains concepts, d’identifier des régularités, etc. Une fois le modèle entraîné, il peut être utilisé sur des données pour produire les résultats attendus.

Les applications de ces techniques d’IA sont en effet nombreuses et puissantes. Au delà des démonstrations symboliques mais sans application concrètrs telles que la capacité de battre un humain aux échecs (deepblue) puis au jeu de go (deepmind), l’apprentissage automatique est déjà utilisé dans plusieurs applications concrètes actuelle telles que la reconnaissance de caractères (utilisés pour le tri du courrier par exemple), la traduction automatique, la reconnaissance vocale, la reconnaissance de formes (utilisée aux portiques des aéroports) ou de visage (pour déverrouiller votre smartphone), et bien d’autres. L’IA est également utilisée dans l’industrie pour la détection d’anomalies ou la maintenance prédictive. D’autres résultats universitaires sont prometteurs tels que la détection de cancer sur photographie (mélanome) ou radios [autres exemples à venir].

Le principe global des approches d’IA par apprentissage automatique sont les mêmes: en intégrant de nombreuses connaissances sur des données existantes, le modèle statistique parvient à capturer des régularités et concepts, et peut assister, voire remplacer le processus humain original.

L’IA générative

D’autres pans de l’IA générative sont devenus populaires. On peut retenir les agents conversationnels (ChatGPT, Claude…) ou la génération d’images (DALL-E, Midjourney…).

Tout comme pour les algorithmes d’apprentissage mentionnés plus haut, ces algorithmes associent à une entrée (le prompt, exprimé en texte) une sortie (un texte pour un agent conversationnel, une image pour la génération d’image).

Ces algorithmes sont en pratique basées sur des mécanismes d’apprentissage automatiques. Un modèle statistique a été entraîné sur un immense corpus (de texte, ou de banques d’images décrites par du texte). Ensuite ces modèles sont utilisés d’une façon différente pour produire des possibilités à partie des connaissances apprises par le modèle.

Les nombreuses approches en IA

En pratique l’IA a d’autres branches que cet apprentissage statistique. Certaines méthodes de modélisation sont d’ailleurs considérées comme de l’IA. D’un point de vue scientifique, il n’y a donc pas de raison d’opposer l’IA et la modélisation.

Pourquoi ne pas utiliser l’IA plutôt que des modèles?

Pour répondre plus précisément, il faut revenir à ce qu’on attend d’un modèle dans l’aide à la décision (évaluer un tendanciel; évaluer les conséquences des options…), et ce dont on a besoin pour aider la décision (objectiver les conséquences des options, choisir entre plusieurs options).

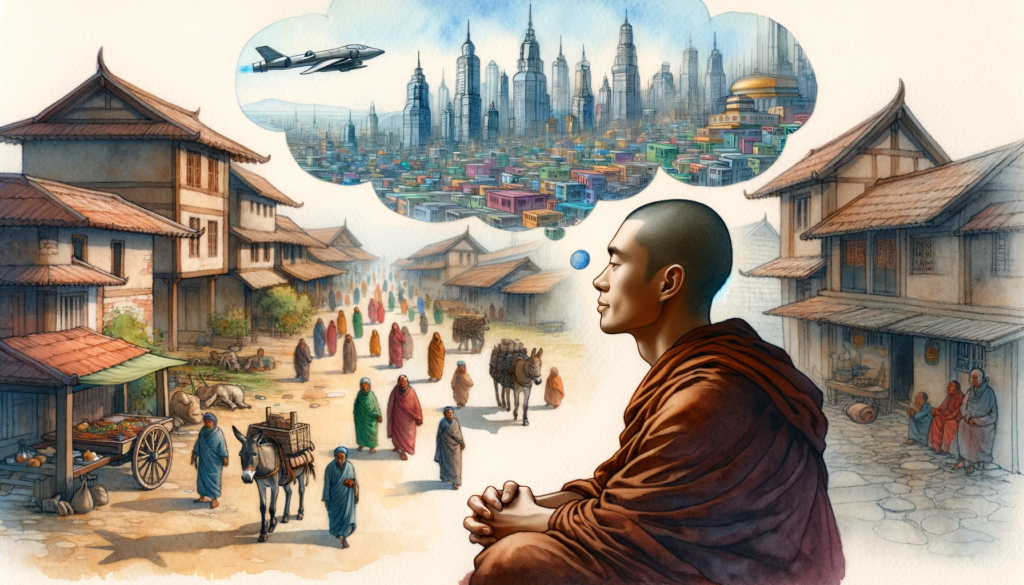

L’IA peut-elle prédire ce qu’elle n’a jamais vu ?

La première question est la faisabilité de l’IA pour l’aide à la décision. Retenons que l’objectif dans modèle pour l’aide à la décision est d’estimer les conséquences d’une action. D’où le modèle puise-t-il sa connaissance ? Dans le cas d’un modèle d’apprentissage automatique, le modèle doit avoir été entraîné sur des cas existants. Si l’objectif est de reproduire des situations de décision passées, alors l’IA pourrait aider à indiquer les conséquences des actions. Si l’objectif est de prendre une décision qui n’a jamais été prise, alors l’IA ne peut avoir été entraînée.

Croyez-vous une boîte noire ?

Chacun peut se poser la question directement: « et si on remplaçait votre médecin par un bot informatique, seriez-vous prêts à croire son diagnostic ? ». Ce diagnostic pourrait être bon, voire très bon.

La seconde question est celle de la confiance accordée aux résultat du modèle. Le décideur s’appuie sur un outil pour améliorer sa décision, et généralement objectiver sa prise de décision. Dans ce cadre, il peut utiliser « l’outil de référence du domaine », ou se reposer sur les résultats de calcul cautionnés par des experts, voire réutiliser une méthode qui a fait ses preuves.

IA et modélisation

un faux antagonisme…

De fait en modélisation, on utilise d’éjà des approches d’apprentissage « boite noire » pour enrichir certaines données manquantes.

… mais de véritables différences dans la confiance

Il reste toutefois un clivage important dans l’usage fait de ces modèles, qui réside dans: « à qui fait-je confiance ? ».

- Dans le cas de la modélisation explicite de connaissances humaines, on accorde notre confiance aux experts qui fournissent le modèle. Ils documentent et expliquent ce qu’ils ont mit dans le modèle. On peut souvent auditer soi-même le modèle, ou au moins construire un rapport de confiance dans le modèle.

- Dans le cas de la modélisation statistique par des méthodes d’IA (apprentissage automatique), on accord la confiance à l’outil.

Pour tenter une analogie, en nous projetant dans les cours de mathématique en Lycée, la modélisation répond à la question en déroulant la démonstration, alors que l’IA donne juste la réponse.

C’est d’ailleurs pourquoi le courant de l’explicabilité de l’IA est si important: pour permettre d’évaluer pourquoi on devrait croire à un résultat de l’outil.

Pour aller plus loin

- les pages wikipedia sur l’apprentissage automatique

- cet article de l’INSERM sur l’IA dans la santé

Références

- (2018): Quels impacts de l’intelligence artificielle sur l’avenir du travail ?. Dans: Personnel, no. 589, p. 46-49, 2018.

Chercheur, modélisation de systèmes énergétiques pour l’aide à la décision